El crepitar de la electricidad dentro del cerebro ha sido durante mucho tiempo demasiado complejo de descifrar. La inteligencia artificial está cambiando eso.

La mujer no se movió, salvo por el ritmo de su respiración, con la mirada fija en la concentración y el puño cerrado. Las palabras se formaban en una pantalla frente a ella, uniéndose lentamente en frases completas. Frases que no podía pronunciar en voz alta.

La mujer de 52 años había quedado paralizada por un derrame cerebral 19 años antes, lo que le impedía hablar con claridad. Sin embargo, aquí, su monólogo interior aparecía ante sus ojos.

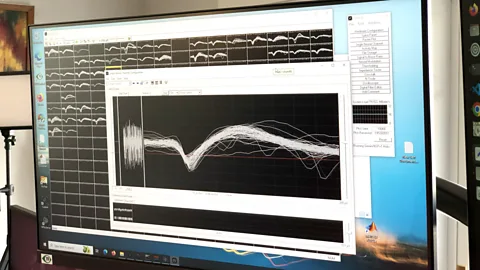

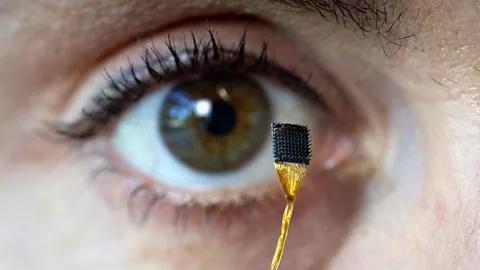

A la mujer, identificada únicamente como participante T16, se le había implantado quirúrgicamente un diminuto conjunto de electrodos en un lóbulo frontal del cerebro. Ahora, una computadora, impulsada por una forma de inteligencia artificial, decodificaba las señales producidas por sus neuronas mientras imaginaba pronunciar palabras, y el sistema las traducía a texto en una pantalla. Participaba en un estudio en la Universidad de Stanford, California, EE. UU., junto con tres pacientes con esclerosis lateral amiotrófica (ELA), una enfermedad neurodegenerativa, para probar una técnica capaz de traducir pensamientos a texto en tiempo real.

Fue lo más cerca que los científicos habían llegado hasta ahora a una forma de «lectura de la mente».

Los investigadores revelaron su éxito en agosto de 2025. Unos meses después, investigadores japoneses revelaron una técnica de «captura mental» capaz de generar descripciones detalladas y precisas de lo que una persona ve o imagina. Esta técnica combinó tres herramientas de IA diferentes con escáneres cerebrales no invasivos para interpretar la actividad cerebral de una persona.

Ambos estudios son los últimos de una serie de avances que ofrecen a los neurocientíficos una nueva perspectiva sobre el funcionamiento interno del cerebro humano y brindan oportunidades para ayudar a las personas que no pueden comunicarse de otras maneras. Sin embargo, con el tiempo, podrían transformar radicalmente la forma en que interactuamos con el mundo que nos rodea e incluso entre nosotros.

«En los próximos años, comenzaremos a ver cómo estas tecnologías se comercializan e implementan a gran escala», afirma Maitreyee Wairagkar, neuroingeniera que ha estado desarrollando interfaces cerebro-computadora en el laboratorio de neuroprótesis de la Universidad de California, Davis, en Estados Unidos. Varias empresas, incluida Neuralink de Elon Musk, ya buscan producir chips cerebrales comerciales que permitan llevar esta tecnología del laboratorio al mundo real. «Es muy emocionante», afirma Wairagkar.

Universidad de California, Davis

Universidad de California, DavisLos científicos llevan un tiempo sorprendentemente largo trabajando en dispositivos capaces de comunicarse directamente con el cerebro humano, conocidos como interfaces cerebro-computadora (BCI). En 1969, el neurocientífico estadounidense Eberhard Fetz demostró que los monos podían aprender a mover la aguja de un medidor con la actividad de una sola neurona cerebral si recibían a cambio una bolita de comida. En un experimento más peculiar de la misma época, el científico español José Delgado logró estimular remotamente el cerebro de un toro enfurecido, deteniéndolo en plena embestida.

Las BCI han sido capaces de decodificar las señales cerebrales que acompañan al movimiento, permitiendo a los usuarios controlar una prótesis o un cursor en una pantalla durante décadas. Sin embargo, las BCI que traducen señales de voz u otros pensamientos complejos a partir de señales cerebrales han evolucionado con mayor lentitud . «Gran parte del trabajo inicial se realizó con primates no humanos… y, obviamente, con los monos no se puede estudiar el habla», afirma Wairagkar.

En los últimos años, sin embargo, este campo ha logrado avances impresionantes en sus esfuerzos por decodificar el habla de personas con capacidades de comunicación deterioradas (por ejemplo, pacientes que sufren ELA, que produce parálisis o síndrome de «enclaustramiento»).

Investigadores de la Universidad de Stanford anunciaron en 2021, por ejemplo, una prueba de concepto exitosa que permitió a un hombre tetrapléjico producir oraciones en inglés imaginándose dibujando letras en el aire con la mano. Con este método, logró escribir 18 palabras por minuto.

¿Podemos decodificar directamente las palabras que la persona está tratando de decir solo a partir de la actividad neuronal? – Maitreyee Wairagkar

El habla humana natural es de aproximadamente 150 palabras por minuto, por lo que la siguiente etapa fue decodificar palabras a partir de la actividad neuronal asociada con el habla misma. En 2024, el laboratorio de Wairagkar probó una técnica que traducía el intento de habla de un hombre de 45 años con ELA directamente a texto en la pantalla de una computadora. Al alcanzar aproximadamente 32 palabras por minuto con una precisión del 97,5 %, esta fue la primera demostración de cómo las BCI del habla podrían facilitar la comunicación cotidiana, afirma Wairagkar.

Universidad de California, Davis

Universidad de California, DavisLa respuesta a la pregunta de si la tecnología podía identificar el habla interna fue un «sí» tentativo. En una tarea que implicaba imaginar una frase, los investigadores lograron una precisión de hasta el 74 % en tiempo real. En las tareas diseñadas para estimular el habla interna espontánea, la precisión fue menor, pero aún superior a la casualidad. Sin embargo, en una condición más abierta, donde se les dieron a los participantes indicaciones como «piensa en tu cita favorita de una película», el lenguaje decodificado fue en su mayoría un galimatías.

«With the current technology, we’re not able to get somebody’s fully unfiltered inner speech perfectly accurately,» said Willett. «But we were able to pick up traces of inner speech pretty clearly in these different tasks.»

The study further illuminated how inner speech might work in our brains. It found that the neural patterns of inner speech were highly correlated with those of attempted speech in the motor cortex, but that the signals emitted were weaker. This echoed previous neuroimaging and electrophysiological studies which found that inner speech engages a similar brain network to physically produced speech.

Beyond words

Wairagkar’s lab at University of California, Davis achieved a breakthrough in 2025 when they showed they could not only decode words, but also the non-verbal parts of speech like intonation, pitch, speed, and rhythm. In essence, it allowed patients to communicate expression and emphasis in addition to the words themselves.

«Human speech is much more than text on the screen,» says Wairagkar. «Most of our communication comes through how we speak, how we express ourselves; what we say has different meanings in different contexts.»

Wairagkar and her colleagues demonstrated their prototype could produce speech out loud as it was attempted by an ALS patient with a severe motor speech disorder.

Better technology will be able to sample more neurons, get richer information, and achieve real time intelligible speech – Maitreyee Wairagkar

Crucially, the participant was able to modulate his words to convey meaning. «Our participant was able to ask a question with an inflection at the end of the sentence, and to change his pitch while speaking,» said Wairagkar. «We demonstrated that through a simple task where he was singing melodies.»

It wasn’t perfect, but 60% of the words were judged intelligible by testers. While still some way behind the best brain-to-text technology, it demonstrated what might be possible in the near future.

Both Wairagkar and Willett believe more progress is imminent. One route to improvement might involve simply increasing the number of microelectrodes placed on the brain. «In our brains, we have billions of neurons and trillions of connections,» says Wairagkar. In her latest study, «we were sampling just 256 of those».

«Newer devices and better technology will be able to sample more neurons, get richer information, and achieve real time intelligible speech,» she adds.

Intelligence Revolution

This article is part of the Intelligence Revolution, a series exploring the new era of intelligence that humanity is now enternig, where the limits of our own brains are being expanded by AI – making the impossible, possible.

Willett está interesado en explorar más a fondo el habla interna, en particular, y planea investigar cómo podrían estar involucradas otras áreas cerebrales fuera de la corteza motora. «Un área que nos interesa es la circunvolución temporal superior», afirma, refiriéndose a un área cerebral involucrada en el procesamiento auditivo, que también podría desempeñar un papel en el habla interna, por ejemplo, «las representaciones auditivas de lo que imaginamos oír dentro de nuestra cabeza».

Mirar más allá de la corteza motora también podría ser importante para ayudar a las personas con lesiones cerebrales en esta región; por ejemplo, las víctimas de un accidente cerebrovascular cuya corteza motora está dañada, pero que aún pueden comprender el habla. Descubrir otras áreas del cerebro involucradas en el habla interna podría algún día ayudar también a estas personas a comunicarse, afirma Willett.

Ver para creer

Mientras que los investigadores de la interfaz cerebro-computadora se centran en aplicaciones prácticas de la tecnología que pueden ayudar a los pacientes, hay otros campos que están haciendo avances en la decodificación de escáneres cerebrales y nos ayudan a entender mejor cómo funciona el cerebro.

Un área se centra en recrear imágenes visualizadas por un individuo simplemente analizando escáneres cerebrales con IA. El proceso funciona así: a los participantes se les muestran imágenes mientras se registra su actividad cerebral mediante resonancia magnética funcional (IRMf), una técnica que mide la actividad cerebral detectando cambios en el flujo sanguíneo a diferentes regiones del cerebro . Los datos neuronales son decodificados por un algoritmo y alimentados a un generador de imágenes de IA, que intenta reproducir las imágenes que el sujeto vio.

Jim Gensheimer/Universidad de Stanford

Jim Gensheimer/Universidad de StanfordLos investigadores llevan décadas intentando resolver este enigma, pero el auge de la IA generativa en los últimos años ha dado un impulso significativo a este campo. Los generadores de imágenes de IA más recientes, como Stable Diffusion, han mejorado enormemente la calidad de las imágenes producidas.

Yu Takagi, profesor asociado del Instituto Tecnológico de Nagoya (Japón), publicó en 2023 un estudio que siguió este método y empleó un algoritmo de difusión estable. El algoritmo se entrenó con un conjunto de datos en línea creado por la Universidad de Minnesota, compuesto por escáneres cerebrales de cuatro participantes que visualizaron un conjunto de 10 000 fotos. En muchos casos, la IA logró reproducir una impresión aceptable de la imagen original, aunque la imagen de una ensaladera no le pareció convincente.

El campo avanza rápidamente. Un estudio publicado el año pasado por investigadores israelíes logró reproducir imágenes aún más precisas.

Estos estudios han ayudado a esclarecer cómo el cerebro procesa la información visual, afirma Takagi. Resulta que dos partes del cerebro son cruciales. El lóbulo occipital, ubicado en la parte posterior del cerebro, codifica los aspectos visuales de bajo nivel de una imagen, como el diseño, la perspectiva y el color. Por su parte, el lóbulo temporal, ubicado detrás de las sienes, codifica los elementos conceptuales de alto nivel que intervienen en la clasificación de la esencia de un objeto.

El sonido de la música

También se están realizando esfuerzos para reconstruir las experiencias auditivas. En 2025, Takagi publicó un estudio que utilizó un algoritmo patentado de Google para intentar reproducir el audio de exploraciones de resonancia magnética funcional (fMRI) tomadas mientras los sujetos escuchaban piezas musicales.

Takagi afirma que esto puede ser más difícil que reconstruir las entradas visuales, ya que la música cambia constantemente, pero el escáner fMRI solo puede completar escaneos a intervalos de un segundo. «La calidad de la reconstrucción es inferior a la de la reconstrucción de imágenes», afirma Takagi. «Aun así, pudimos reconstruir el carácter de la música y la categoría básica».

Este campo ha contribuido a nuestra comprensión de la base neuronal de la percepción musical.

«Lo que nos sorprendió de este estudio es que la percepción de la música en el cerebro es diferente a la de las imágenes», afirma Takagi. «En el caso de las imágenes, la información de alto y bajo nivel se ubican en lugares distintos del cerebro. En el caso de la música, descubrimos que la semántica y la información de bajo nivel no están separadas».

Más como esto:

• Los acertijos que los humanos pueden resolver pero las computadoras no pueden

• Un píxel en la nieve: cómo la IA encontró a un escalador perdido

• Los ‘espejos de IA’ están cambiando la forma en que las personas ciegas se ven a sí mismas

Takagi está entusiasmado con algunas de las posibles aplicaciones de estos enfoques. Podrían recrear las alucinaciones auditivas y visuales de pacientes psiquiátricos, como los esquizofrénicos, para comprender mejor sus afecciones, afirma. Las técnicas podrían utilizarse para recrear lo que los animales experimentan al procesar el mundo, o incluso para reconstruir sueños.

«Mucha gente pregunta sobre eso», dice Takagi riendo. Dice que le gustaría recrear sueños algún día, pero que por ahora sigue siendo extremadamente complicado. Algunas investigaciones incluso han planteado la posibilidad de la comunicación directa entre cerebros , incluso con varias personas a la vez , aunque las implicaciones éticas y los problemas de derechos humanos relacionados con los dispositivos que lo permiten aún no se han descifrado por completo.

Para quienes esperan que también sea posible estimular experiencias visuales o auditivas en el cerebro con fines de entretenimiento, Takagi recomienda paciencia. Si bien esto es teóricamente posible, afirma que las limitaciones técnicas probablemente no ocurrirán hasta dentro de 10 a 20 años.